近日,由黑芝麻智能主办的"2023智能汽车高峰论坛"汇聚了众多行业专家和企业代表。在其中的软件论坛上,来自不用领域的嘉宾共同探讨新形势下汽车软件行业的未来。黑芝麻智能深度学习研发高级总监王祚官在论坛上发表了主题为"BEV感知,给自动驾驶开启‘上帝视角'"的主旨演讲,分享黑芝麻智能在BEV感知方面的研发进展。

感知质量更好的前融合方案

BEV是Bird's-Eye-View Perception的缩写,即鸟瞰视角感知,简单而言就是融合车载多视角摄像头的输入,然后变成鸟瞰图的检测输出,可用于各种下游任务。

相校于传统的感知算法,BEV感知有明显优势。如果把多视角的感知看作一个融合过程,传统的感知算法可以看作是一个后融合方案,其典型做法是对每一路输入的视频做单独检测,然后通过一些方法把检测结果融合起来。其缺点是会产生一些比较大的累计误差。

BEV感知则属于前融合感知,把图像特征先融合起来,直接生成BEV的检测结果,如此省去了很多中间步骤,生成的感知结果质量比后融合方案的更好。

王祚官表示,BEV感知能为自动驾驶感知任务提供有效的时空表征方法,将成为车载感知的主流发展方向。

黑芝麻智能开发多重亮点的BEV技术

王祚官介绍,黑芝麻智能的BEV框架主要分三部分:第一部分是特征提取,对每一路输入的图像,提取其图像特征;第二部分是BEV的特征生成,包含空间的融合和时间的融合;第三部分是目标检测。

整体而言,黑芝麻智能开发的BEV技术有诸多亮点:上下文感知增强的BEV投影,可自适应时空采样,可学习车道结构的码本,基于"BST渲染器"的实时矢量化地图构建能力,结合"NeRF + LiDAR"的 Occupancy Grid Map(占位栅格地图)功能 ,以及芯片本身的高效网络架构与强大性能。

在将图像投影到三维空间时,现有方法仅从一条光线中采样上下文特征。黑芝麻智能采用了上下文感知的增强BEV,图象包括非常丰富的场景信息,最终可以得到质量非常高的BEV。

空间的融合之后,紧接着就是时间的融合,典型做法是把当前均匀采样的帧融合在一起。但这样做有一个明显问题,即车辆停止的时候,采样会产生大量重复的帧,造成之前的路面信息丢失,导致算力浪费,而且感知范围会变小。黑芝麻智能的做法是增加了空间上的抽样,即根据车身信息,每隔一定的距离做抽样,然后把空间抽样和时间抽样结合起来,作为最后的目标检测。通过这种方式,车辆在缓慢行驶甚至停止的情况下,仍然能够保证有较大的感知范围。

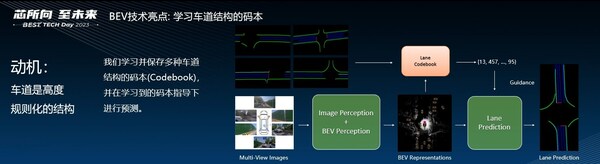

车道是高度规则化的结构,黑芝麻智能设计了用低维编码的方法来引入车道线的结构信息,学习并保存多种车道结构的码本(Codebook),并在学习到的码本指导下进行预测。

在车辆周围实时生成地图对自动驾驶非常关键。但是,地图通常包含很多种类的元素,比如车道线、人行道、停车位等,这给网络实时预测周围地图带来了困难。黑芝麻智能采用矢量的方法作为统一的表达方式,开发了可微分的"BST-Renderer",将各种地图元素渲染成图像,然后对渲染出的图像进行训练。用一致的矢量表示,的好处就是说,为后期的矢量地图构建提供了便利。

在提到OCCUPANCY GRID时,王祚官表示,一个空间是否被占据,表示方法是把它离散化成等大小的立方体,用一个参数来表示这个立方体被占据的概率是多少。传统的典型做法是使用LiDAR信号,但会出现信号缺失或被遮挡的问题。黑芝麻智能设计了"NeRF + LiDAR"的方案,与仅使用 LiDAR相比,可端到端训练,充分结合图像信息和LiDAR信息,对被遮挡区域依然可以进行场景流监督,可使用无LiDAR数据集进行模型微调。

此外,BEV模型里面使用了很多Transformer模型,鉴于Transformer注意力机制的计算成本较高,黑芝麻智能简化了计算,使其适合在边缘设备上运行。

自研高性能芯片为BEV模型落地提供支持

黑芝麻智能已将开发的BEV模型部署到旗下华山二号A1000芯片上。A1000芯片拥有58TOPS(INT8)的强大算力,有矩阵运行单元和非线性运算单元,再加上DSP,能够满足行业需求。与此同时,BEV模型还可部署在黑芝麻智能最新发布的武当系列C1200芯片上。该系列是业内首个智能汽车跨域计算芯片平台。

作为中国本土自动驾驶芯片的供应商之一,黑芝麻智能拥有全栈感知算法量产化能力,能够提供客户算法定制服务,支持第三方算法移植,多种算法交付方式等灵活的商业模式。这些感知算法能够加速并且助力一些中短期内智能领航和泊车应用产品快速落地,从而加速整个芯片的量产及应用。

稿源:美通社