作者:电子创新网张国斌

在2024上海国际嵌入式大会 embedded world China Conference同期召开的芯原AI专题技术研讨会上,芯原执行副总裁、IP事业部总经理戴伟进在发言分享了了大模型(Large Models)在推动边缘计算变革中的机遇与挑战,同时,也对芯原在人工智能领域的产品布局做了分享。

他指出,大模型已经在各行各业带来了显著变化,尤其在嵌入式系统和边缘设备中的应用日益显著。戴伟进强调,多模态大模型能够实现深层次的智能水平,推动AI技术在各个领域的爆发式发展。例如,OpenAI的GPT Store和Sora视频生成模型,以及谷歌的Project Astra项目,都展示了大模型在商业应用中的广阔前景。

此外,大模型在嵌入式系统和边缘设备中的应用尤为突出,主要包括手机、AI-PC和汽车等。通过自然的人机交互、多模态能力、更自然的对话和更真实的信息,大模型能够极大提升用户体验。

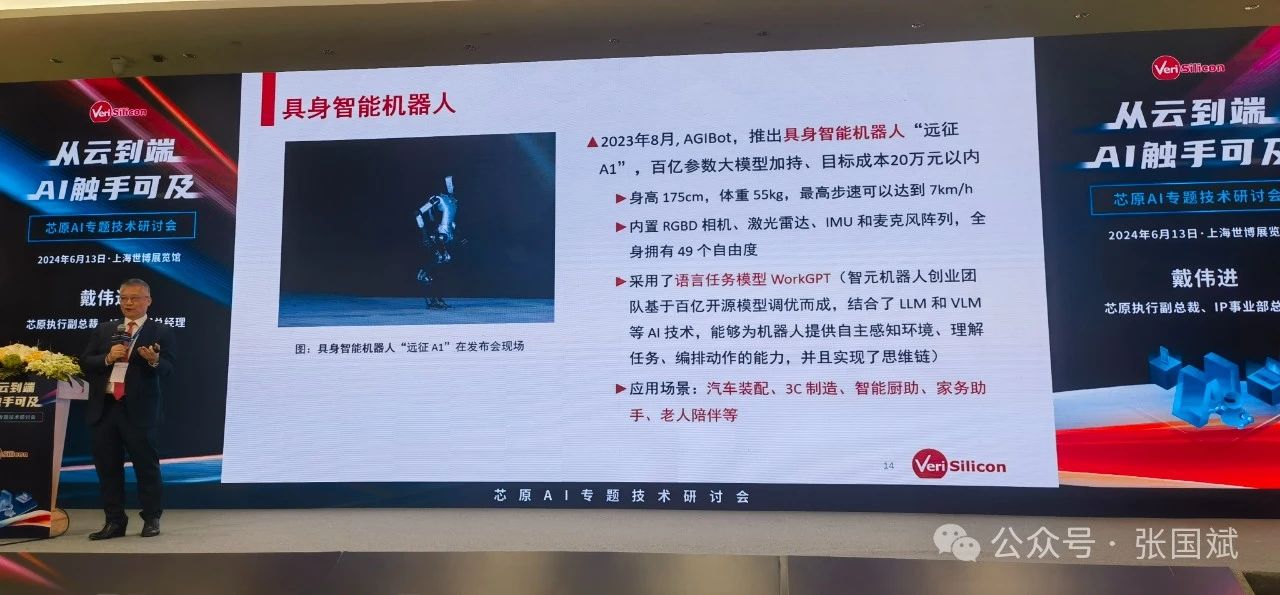

另外,AGIBot的“远征A1”具身智能机器人,通过结合LLM和VLM等AI技术,实现了自主感知环境、理解任务和编排动作的能力。这进一步证明了大模型在机器人领域的应用潜力。

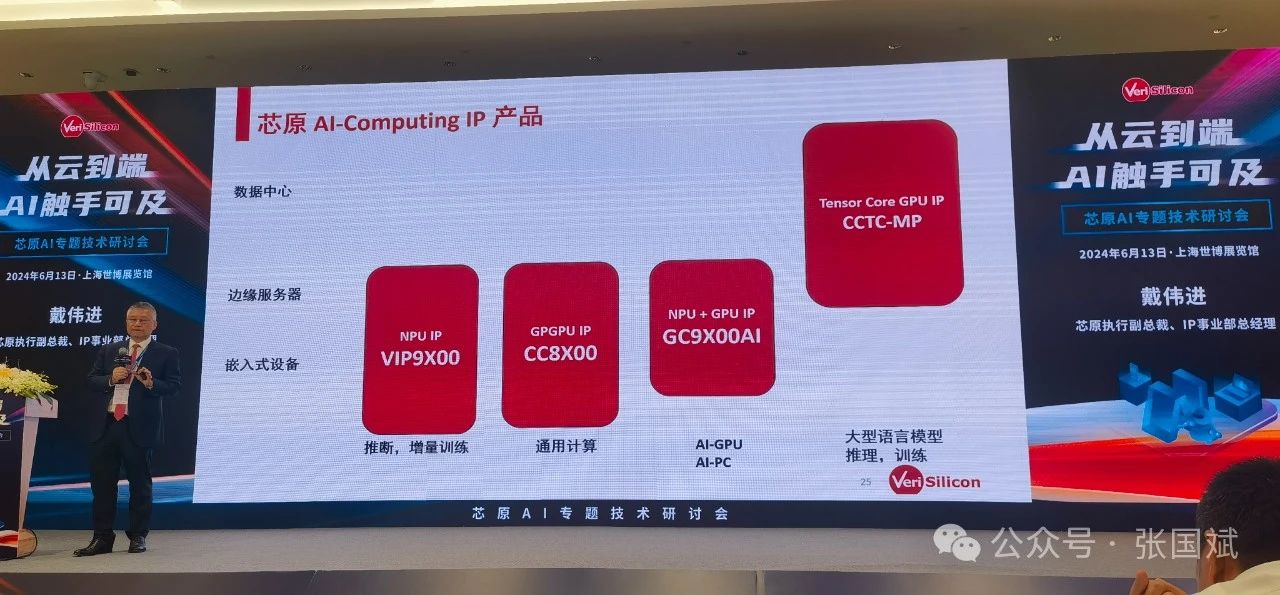

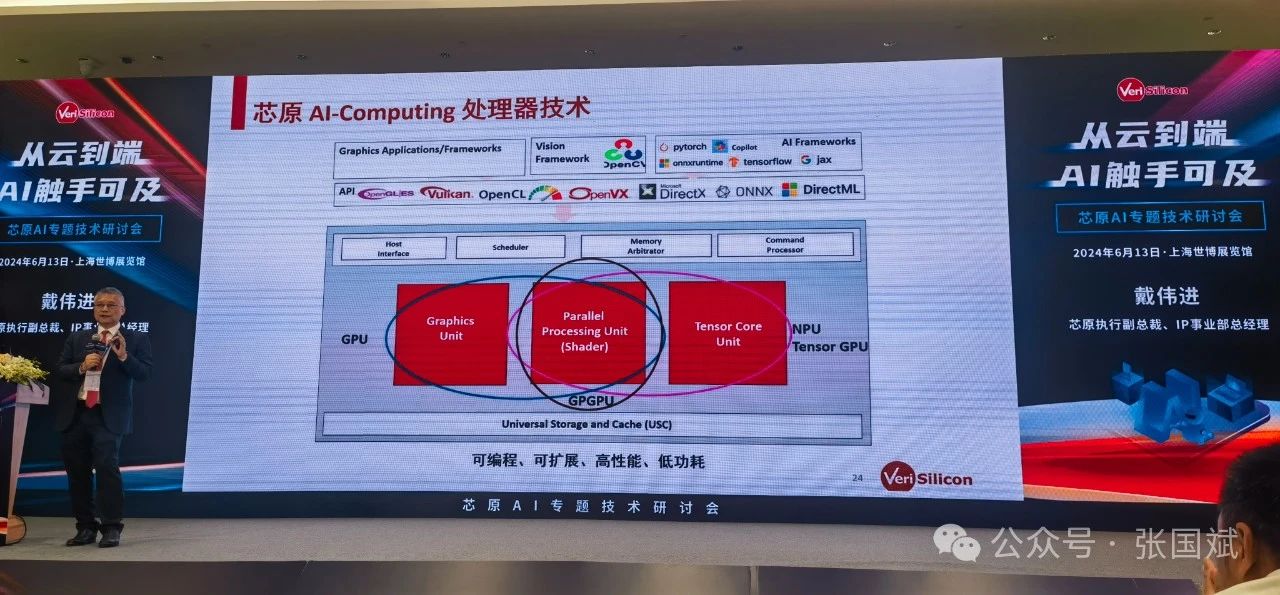

在讨论大模型和边缘计算的机遇与挑战时,戴伟进也提到了GPGPU(通用图形处理单元)的重要性和未来发展方向,他表示GPGPU的主要优势在于其强大的并行计算能力,这使其在处理大规模数据和复杂计算任务时表现出色。戴伟进指出,芯原的GPGPU IP CC8X00专为通用计算设计,能够有效应对多样化的计算需求。随着AI技术的发展,GPGPU在大模型训练和推理中的应用越来越广泛。戴伟进提到,芯原的Tensor Core GPU IP CCTC-MP专注于大模型预演模型的推理和训练,展示了GPGPU在支持AI应用中的关键作用。

他认为GPGPU的未来发展方向有三个:

1. 高性能和低功耗的平衡:未来的GPGPU发展将更加注重在高性能和低功耗之间找到平衡。芯原的AI-Computing处理器技术已经展示了其在这方面的优势,能够满足各种应用场景的需求。

2. 可编程性和扩展性:戴伟进强调,GPGPU未来的发展将继续提升其可编程性和扩展性,以应对不断变化的计算需求。芯原的产品布局中,GPGPU IP CC8X00正是为了满足这一需求而设计的。

3. 边缘计算的应用:随着边缘计算的兴起,GPGPU在边缘设备中的应用将越来越重要。戴伟进提到,芯原的AI-Computing处理器技术已经在边缘设备中运行大模型,如AI-PC、医疗系统设备和工业应用领域,这为GPGPU在边缘计算中的广泛应用奠定了基础。

4. AI赋能智能视频处理:芯原的视频处理器(VPU)和GPGPU的结合,展示了其在AI视频处理领域的领先地位。未来,GPGPU将进一步推动智能视频处理的发展,为用户带来更优质的体验。

针对这样的发展趋势,他分享了芯原的产品布局,戴伟进表示在大模型和AI技术的推动下,芯原已经布局了多个领域的产品,涵盖了从嵌入式市场到边缘计算的广泛应用。

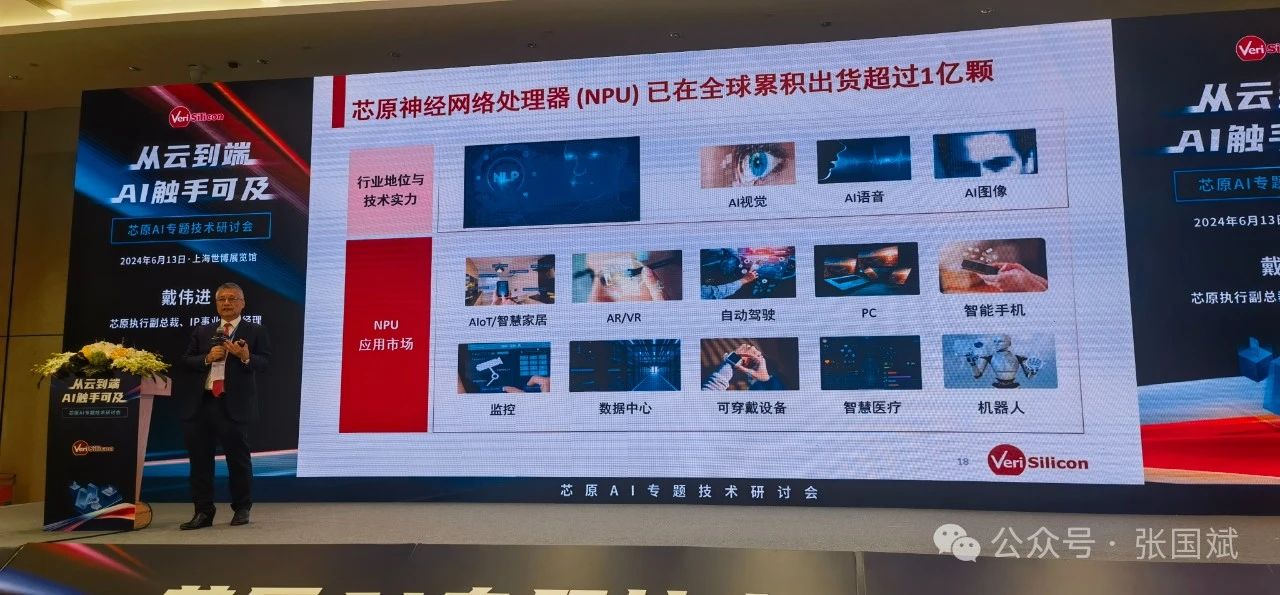

芯原自2016年开始人工智能NPU的开发,目前,芯原的NPU已经在全球累计出货超过1亿颗,应用于AI视觉、AI语音、AI图像、AIoT/智慧家居、AR/VR、自动驾驶、PC、智能手机、监控、数据中心、可穿戴设备、智慧医疗和机器人等领域。

关于芯原在NPU领域的布局发展详见《产品创新与生态双轮驱动:芯原NPU的成功故事》

他透露在图形处理器(GPU)方面,芯原的GPU出货量接近20亿颗,拥有70项国内外专利。其在嵌入式市场耕耘近20年,AI赋能智能视频处理等行业取得了显著成绩。

在视频处理器(VPU)方面,芯原的视频处理器在全球范围内具有领先地位,广泛应用于AI视频和智能视频处理。

他还特别介绍了芯原的AI-Computing处理器技术,芯原的AI-Computing处理器技术具备可编程、可扩展、高性能和低功耗的特点,涵盖了数据中心和边缘服务器等应用。其NPU IP VIP9X00支持推断和增量训练,GPGPU IP CC8X00适用于通用计算,NPU+GPU IP GC9X00则专注于AI-GPU/AI-PC,Tensor Core GPU IP CCTC-MP适用于大模型推理和训练。

人工智能离不开软件生态的开发,他表示在软件框架方面,芯原的Acuity工具、库和软件堆栈构成了其AI-Computing软件框架。Project Open Se Cura实现了边缘与云协同计算,应用于谷歌眼镜等设备,实现极低功耗、常开和环境计算。

注:本文为原创文章,未经作者授权严禁转载或部分摘录切割使用,否则我们将保留侵权追诉的权利