作者:电子创新网张国斌

随着人工智能应用日益普及,人工智能加速芯片水涨船高,目前,英伟达已占据全球AI计算芯片市场的80%到95%份额,这是绝对的市场垄断,在英伟达GPU赚的盆满钵满之时,国际芯片巨头们也纷纷向其发出了挑战,英特尔、AMD、谷歌以及一些新创公司都在开发可以替代或者蚕食英伟达GPU的替代产品,这其中,Tenstorrent的芯片最受业界关注。

因为Tenstorrent拥有一支来自苹果、AMD等公司的资深工程师团队,这些工程师具备丰富的芯片设计和AI技术经验,为公司的技术创新和产品开发提供了强大的支持。其联合创始人兼首席技术官(CTO)是Jim Keller,他在在半导体和计算机体系结构设计方面拥有丰富的经验,曾在苹果、AMD、特斯拉和英特尔等公司担任要职

Jim Keller表示, Tenstorrent的目标是可以比类似性能的GPU系统便宜5到10倍。 Tenstorrent使用的内存带宽要少得多,因为有一个图形编译器,而且Tenstorrent的架构比GPU更像是一台数据流机器,所以可快速将数据从一个处理元素发送到另一个处理元素。这样就避免了使用昂贵的HBM硅中介层。此外,Tenstorrent的芯片上有网络端口,利于通过网线互联组成大型阵列集群进行横向扩展,而无需通过其他交换机,因此,其成本要比。英伟达的方案更便宜。

在昨天2024世界人工智能大会同期召开的RISC-V与生成式AI论坛上,TenstorrentInc.首席CPU架构师、机器学习硬件架构资深院士练维汉发表了在线演讲,解释了为什么RISC-V架构适合做人工智能加速芯片?

练维汉认为RISC-V架构做AI计算有几个优势:

1. 开源与灵活性

RISC-V是一种开源的指令集架构(ISA),这意味着其设计是公开的,任何人都可以使用、修改和扩展。这种开源特性为芯片设计者提供了极大的灵活性,可以根据具体需求定制AI加速器。这种灵活性特别适用于AI领域,因为AI工作负载往往需要特定的优化才能达到最佳性能。

2. 高度的可扩展性

RISC-V的指令集非常精简,但同时也高度可扩展。设计者可以根据需要添加自定义指令集扩展,以增强AI计算的性能和效率。例如,可以增加向量扩展或其他专用于AI的指令集,从而提升计算速度和能效。

3. 功耗和效率

在AI计算中,功耗和效率是两个关键因素。RISC-V架构通过其简洁的设计和定制化的扩展,可以实现高效的能量使用。练维汉指出,RISC-V架构能够通过小型且高效的处理单元,减少等待数据传输的时间,从而提升整体计算效率。

4. 生态系统和社区支持

RISC-V的开源性质吸引了全球大量的开发者和公司加入其生态系统。这个广泛的社区支持为RISC-V的发展提供了强大的推动力,同时也带来了丰富的IP资源。这种生态系统的多样性和开放性,使得RISC-V架构在AI硬件领域具备了良好的发展前景。

Tenstorrent的布局和优势

他也分享了Tenstorrent在AI计算上的布局,他指出Tenstorrent在RISC-V架构上的布局展现了其在AI硬件领域的战略和优势。

Tenstorrent认识到AI对算力的巨大需求,并将其作为公司的核心任务。通过采用RISC-V架构,Tenstorrent能够灵活地设计和优化AI加速芯片,满足不同应用场景下的算力需求,从边缘设备到数据中心,均能提供相应的算力解决方案。

另外,Tenstorrent不仅开发芯片,还提供完整的软硬件解决方案,包括AI加速IP、Chiplet和System Chiplets等。这种全方位的产品线使得Tenstorrent能够为客户提供灵活、定制化的解决方案,满足不同层次的AI计算需求。

目前Tenstorrent已经与三星、LG等全球知名企业建立了合作伙伴关系。这些合作伙伴在各自的领域内具有重要影响力,能够帮助Tenstorrent扩大其市场覆盖面和影响力。

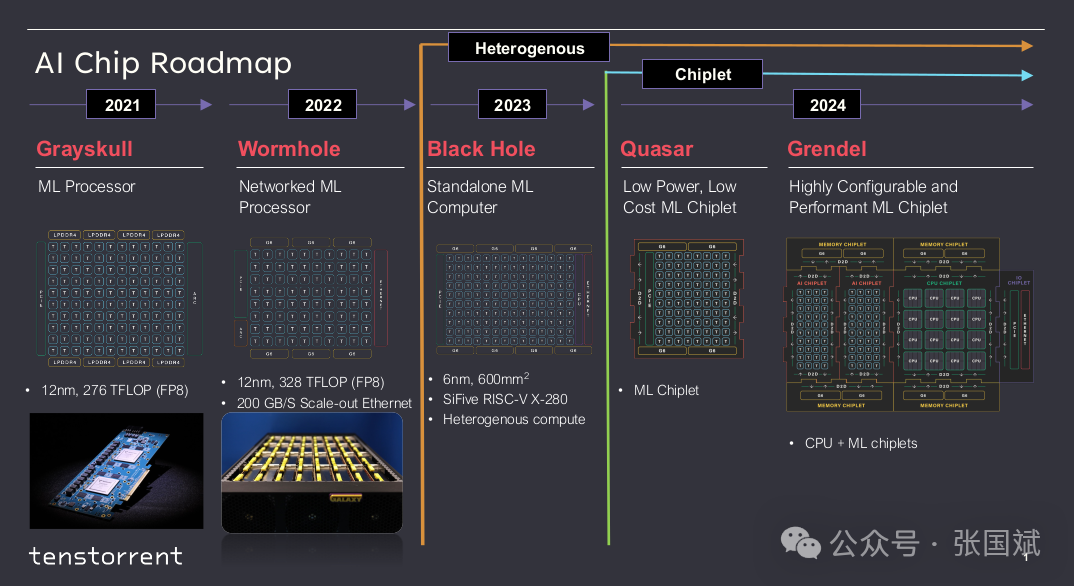

目前,Tenstorrent 已推出两款 AI 加速器产品,Grayskull 和 Wormhole,并计划推出两款 CPU+ML 解决方案产品,Blackhole 和 Grendel。这些产品将为用户提供多样化的选择,以满足不同的计算需求和应用场景。以下是产品路线图(Blackhole推迟了)。Grayskull可提供约315 INT8 TOPS的性能,可插入PCIe Gen4插槽,以及网络WormholeML处理器,具有约350 INT8 TOPS 的性能并使用GDDR6 内存子系统,一个PCIe Gen4 x16接口等。

Grayskull

Grayskull芯片采用 GlobalFoundries 12nm 工艺,尺寸为620mm^2。

Wormhole

Wormhole芯片采用 GlobalFoundries 12nm 工艺,尺寸为670mm^2。

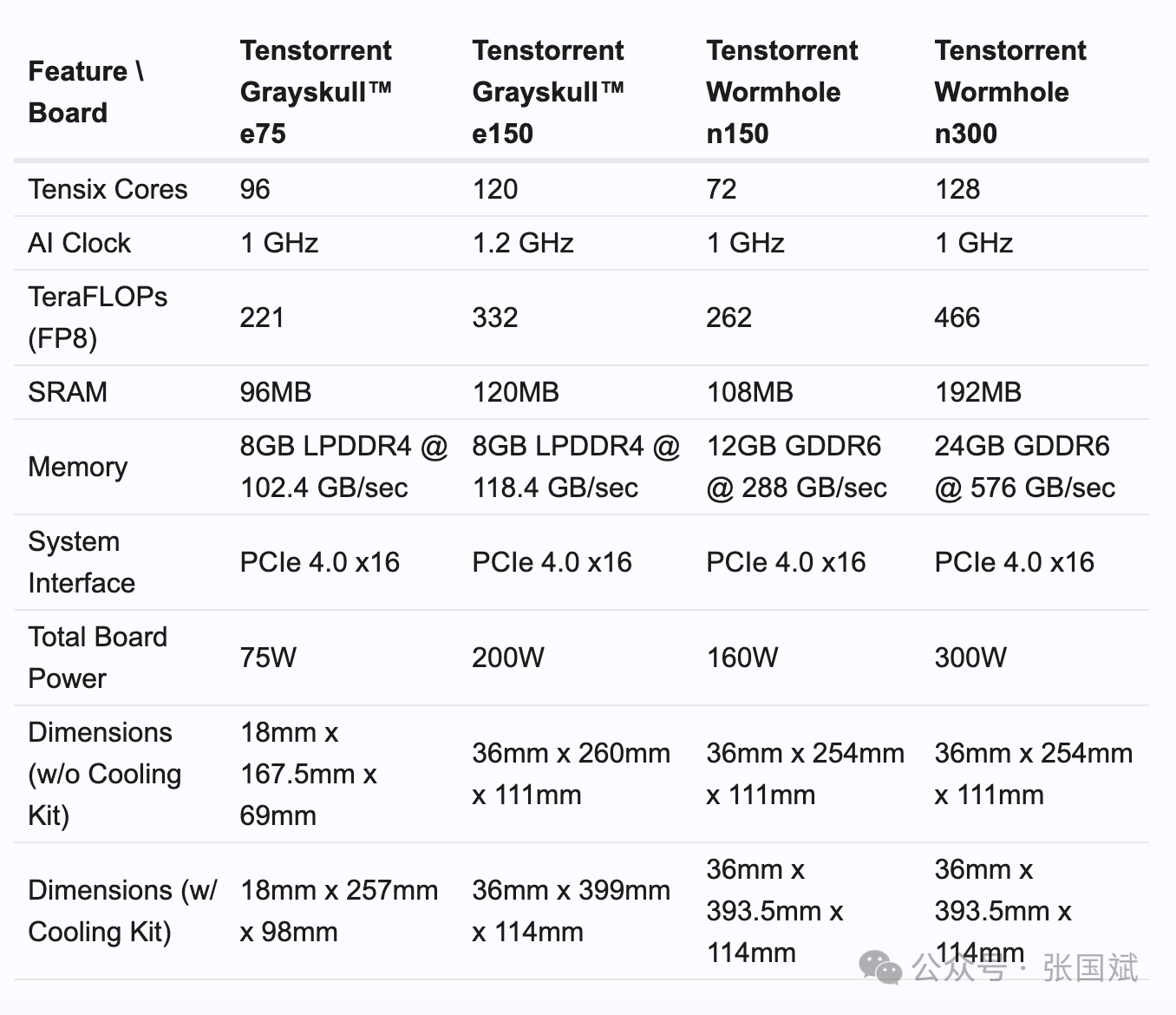

Wormhole和Grayskull板卡性能对比如下:

相对于Grayskull芯片,Wormhole芯片的Tensix核进行了升级。每个核心容纳了更多的SRAM,并且具备执行更复杂的数学运算以及SIMD指令的能力。具体来说,Wormhole芯片的Tensix核配备了1.5MB的SRAM,而Grayskull芯片的Tensix核只有1MB的SRAM。此外,一个显著的不同之处在于Wormhole芯片增加了16个100Gb以太网端口。这些以太网端口的增加使得许多芯片可以连接在一起,从而扩展计算资源。

Blackhole

与Grayskull和Wormhole不同的是,Blackhole不再是单纯的AI加速器,而是集成了CPU和AI加速器的解决方案。它融合了24个SiFive X280 RISC-V内核和多个第三代Tensix内核。该设备将提供1 INT8 POPS(Peta Operations Per Second)的计算吞吐量,性能相比前代产品提升约三倍。此外,它还配备了八通道GDDR6内存、1200 Gb/s以太网连接和PCIe Gen5通道。Blackhole采用6nm级制造工艺。值得注意的是,Blackhole尚未正式推出(已经有测试样片),因此最终产品可能与目前披露的内容有所不同。

Grendel

Grendel作为一项计划产品,将采用Tenstorrent自己的RISC-V核Ascalon,取代SiFive X280 RISC-V内核。

如何破解生态难题?

目前,英伟达的CUDA生态被很多人认为是无法逾越的护城河,不过Jim Keller在今年2月曾批评英伟达的 CUDA架构和软件堆栈不是护城河而是“沼泽”。他指出,就连英伟达本身也有多个专用软件包,出于性能原因,这些软件包依赖于开源框架。

练维汉指出Tenstorrent在解决AI应用的生态问题上采取了一系列措施,从硬件设计、软件支持到合作伙伴关系的构建,全面打造一个完整而灵活的AI计算生态系统。

首先Tenstorrent设计的专用AI加速芯片基于RISC-V架构,能够高效地处理AI计算任务。通过灵活的RISC-V指令集,Tenstorrent可以根据具体的AI应用需求进行定制,提供优化的计算性能和能效。

其次,Tenstorrent采用Chiplet设计,通过将不同功能模块集成到一个芯片中,满足多样化的AI计算需求。这种模块化设计不仅提高了芯片的灵活性,还降低了开发成本和时间。

此外,Tenstorrent还开发了BUDR和METALIUM软件框架,支持AI模型的高效运行和优化。这些软件工具为开发者提供了易于使用的接口,简化了AI应用的开发和部署。

他还特别指出Tenstorrent确保其硬件和软件与主流AI框架(如TensorFlow、PyTorch等)兼容,使得开发者可以无缝地将现有的AI模型迁移到Tenstorrent的计算平台上,降低了迁移成本和复杂性。

他表示Tenstorrent还积极参与RISC-V和AI硬件领域的行业标准制定,与其他公司和组织合作,共同推动技术标准化。这有助于建立一个更加开放和互操作的生态系统。Tenstorrent也提供广泛的社区支持和培训资源,帮助开发者更好地理解和使用其硬件和软件产品。这包括在线文档、教程、示例代码以及社区论坛,确保开发者能够迅速上手并解决实际问题。

他表示Tenstorrent不仅专注于传统的AI计算领域,还积极探索新兴的应用场景,如边缘计算、物联网和自动驾驶等。通过拓展跨领域应用,Tenstorrent进一步扩大了其生态系统的覆盖范围。

总之他表示Tenstorrent通过硬件创新、软件支持、合作伙伴关系、开源社区参与和持续优化,全面解决了AI应用的生态问题。其RISC-V架构的灵活性和可扩展性,使得Tenstorrent能够提供高效的AI计算解决方案,并在激烈的市场竞争中脱颖而出。未来,随着技术的不断进步和生态系统的进一步完善,Tenstorrent有望在AI计算领域占据更加重要的地位。

对此,大家怎么看?

注:本文为原创文章,未经作者授权严禁转载或部分摘录切割使用,否则我们将保留侵权追诉的权利